Mỗi mùa xuân, hàng nghìn kỹ sư phần mềm lại hội quân về San Jose, bang California, để chiêm ngưỡng những bộ vi xử lý siêu tốc mới nhất và tham dự các lớp đào tạo lập trình tại GTC – hội nghị nhà phát triển thường niên của Nvidia.

GTC vốn là viết tắt của GPU Technology Conference (Hội nghị Công nghệ GPU), nhưng có lẽ cái tên này sắp trở nên lỗi thời.

Năm nay, lần đầu tiên kể từ khi khai mạc vào thứ Hai, trọng tâm của sự kiện sẽ không còn đặt hoàn toàn vào GPU (đơn vị xử lý đồ họa) – dòng chip mạnh mẽ độc nhất vô nhị đã giúp Nvidia xây dựng nên đế chế điện toán khổng lồ và vươn mình trở thành công ty niêm yết lớn nhất thế giới.

Thay vào đó, chủ đề bao trùm các cuộc thảo luận sẽ là "suy luận" (inference) – loại hình điện toán cần thiết để vận hành các mô hình AI và giúp chúng phản hồi các truy vấn từ người dùng.

Sự trỗi dậy của "Suy luận"

Đây là dấu hiệu cho thấy ngành công nghiệp trí tuệ nhân tạo đã dứt khoát bước sang một giai đoạn mới. Các khách hàng của Nvidia giờ đây ít bận tâm hơn đến việc huấn luyện các mô hình AI lớn – thế mạnh tuyệt đối của GPU – mà thay vào đó là tập trung vận hành chúng để thu về lợi nhuận khổng lồ từ người dùng cuối.

So với các dòng chip tối ưu cho huấn luyện, "suy luận" đòi hỏi một bộ phần cứng khác biệt: hiệu suất năng lượng cao hơn, kết nối liên thông nhanh hơn và bộ nhớ băng thông cao hơn.

CEO của Nvidia, ông Jensen Huang, đã không ít lần quảng bá rằng 2026 sẽ là năm mà "suy luận nuốt chửng AI". Tại một hội nghị nhà đầu tư diễn ra vào ngày 4/3, ông thừa nhận: "Bước ngoặt mà chúng ta đang thấy ở đây thực tế đã lộ diện rõ ràng từ lâu; đó cơ bản là khả năng AI sử dụng các tệp tin, truy cập dữ liệu và vận hành các công cụ."

Khi AI bắt đầu "đẻ ra tiền"

Các chức năng này, được gọi chung là AI tác nhân (agentic AI), phụ thuộc gần như hoàn toàn vào điện toán suy luận. Đây cũng chính là niềm tin cốt lõi rằng AI sẽ thay đổi toàn diện nền kinh tế toàn cầu.

Sự tăng tốc chóng mặt trong năng lực của các tác nhân đang tạo ra cơn bùng nổ nhu cầu về sức mạnh tính toán. Theo ông Huang, các công ty như OpenAI hay Anthropic – những đơn vị vận hành các tác nhân lập trình phổ biến là Codex và Claude Code – hiện đang tạo ra lượng "token" suy luận (đơn vị đo lường cơ bản của dữ liệu đầu ra trong AI tạo sinh) gấp hàng nghìn lần so với trước đây.

Kỷ nguyên Suy luận chính là điều mà các công ty công nghệ ở mọi quy mô đã chờ đợi từ lâu. Đây là nơi bài toán kinh tế của điện toán AI có khả năng đảo chiều từ lỗ sang lãi – với điều kiện chi phí cung cấp năng lượng tính toán phải được giữ ở mức đủ thấp.

Các công ty AI đang chuyển dịch từ giai đoạn tăng trưởng (vốn phải đổ những khoản tiền khổng lồ vào hạ tầng huấn luyện, bao gồm việc mua hàng triệu GPU thế hệ mới nhất như Hopper và Blackwell) sang giai đoạn thương mại hóa sản phẩm thông qua phí đăng ký hoặc đo lường mức độ tiêu thụ trí tuệ.

"Điều thực sự quan trọng cần nhận ra là đối với khách hàng của chúng tôi, suy luận hiện giờ chính là doanh thu, bởi các tác nhân đang tạo ra rất nhiều token với kết quả cực kỳ hiệu quả," ông Huang phát biểu trong cuộc họp báo cáo kết quả kinh doanh gần nhất.

"Chúng ta cần thực hiện suy luận ở tốc độ cao hơn nhiều, và khi đó, mỗi token được tạo ra đều có thể quy đổi thành tiền, trực tiếp chuyển hóa thành doanh thu."

Thách thức từ những đối thủ mới

Thách thức hiện tại của Nvidia là các sản phẩm bán chạy nhất của họ lại kém hấp dẫn đối với điện toán suy luận hơn là huấn luyện. Người dùng phản ánh rằng các máy chủ Grace Blackwell tiêu tốn lượng điện năng khổng lồ và không có đủ bộ nhớ để các mô hình AI có thể đưa ra câu trả lời nhanh chóng và hiệu quả.

Paul Kedrosky, nhà đầu tư mạo hiểm và nghiên cứu viên tại Sáng kiến về Nền kinh tế Kỹ thuật số của MIT, nhận định: "Nvidia đang ở một thời điểm kỳ lạ. Đã có lúc Jensen nói rằng chúng ta không cần các chip suy luận chuyên dụng, cứ ném Blackwell vào là xong. Nhưng con tàu đó đã rời bến và hiện có hàng tá đối thủ cạnh tranh mới."

Ông Kedrosky lập luận rằng biên lợi nhuận gộp của Nvidia (đạt 73% trong quý gần nhất) chắc chắn sẽ phải giảm xuống vì hai lý do. Thứ nhất, mô hình kinh doanh suy luận ưu tiên hiệu quả và cắt giảm chi phí tạo ra sản phẩm cuối cùng (các công cụ AI). Phần cứng không được quá đắt đỏ, nếu không các công ty bán dịch vụ sẽ không thể có lãi.

Thứ hai, sự cạnh tranh đang gia tăng khi nhiều công ty chip đã tìm ra cách cung cấp năng lượng suy luận bằng các dòng chip rẻ hơn cả về giá mua lẫn chi phí vận hành. Nvidia đã trở thành công ty 4.000 tỷ USD đầu tiên nhờ bán những "chiếc Ferrari silicon" đắt đỏ, nhưng giờ đây thế giới lại đang cần những chiếc Prius hay Model Y.

"Mảng suy luận này là mối đe dọa cực lớn đối với Jensen vì nó hoàn toàn bị thúc đẩy bởi hiệu suất," Kedrosky nói thêm. "Ông ấy đang tuyệt vọng tìm cách mở rộng đế chế của mình sang mảng này."

Cuộc xoay trục quyết liệt

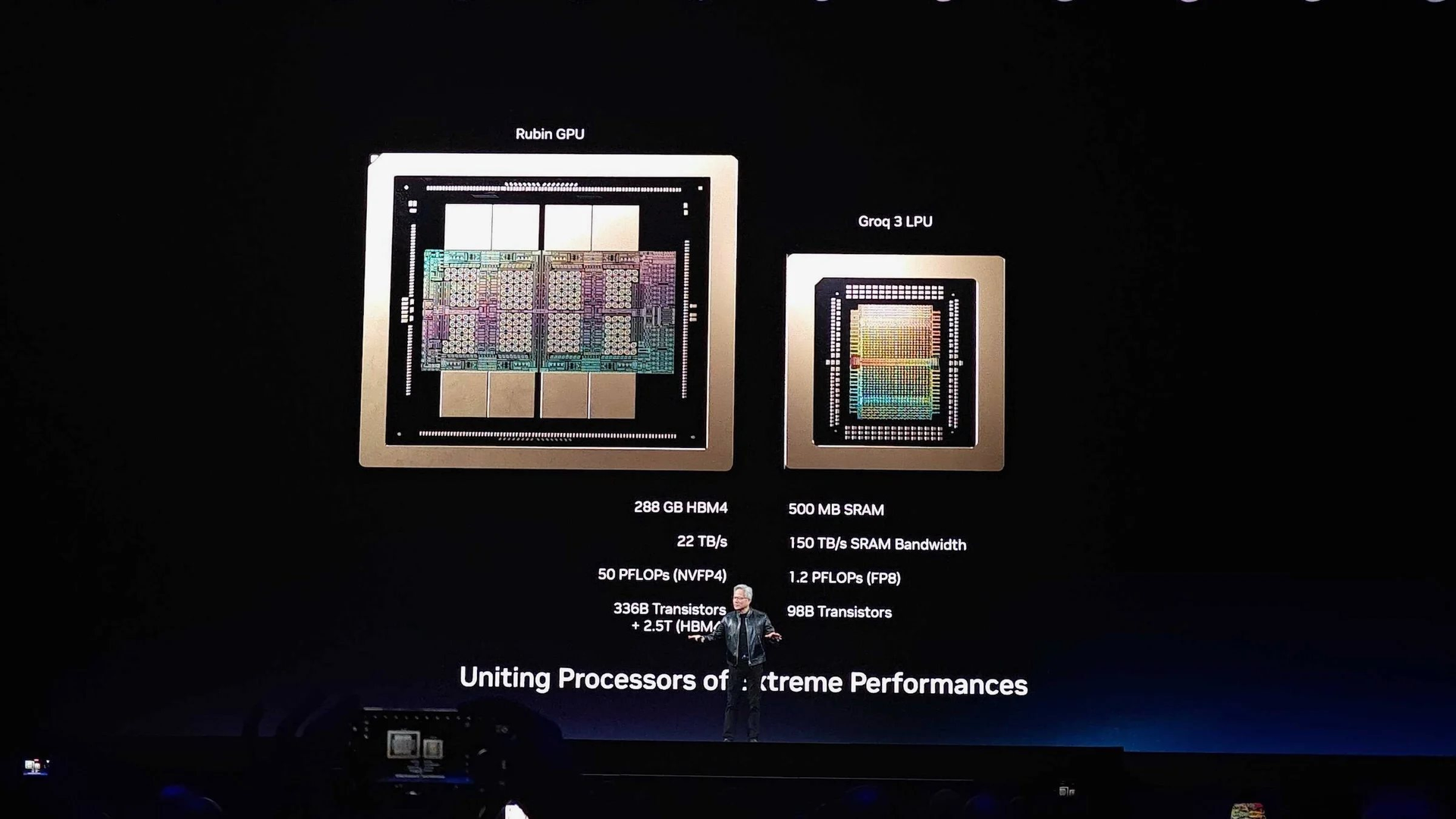

Vào tháng 12, Nvidia đã chi 20 tỷ USD để cấp phép công nghệ chip và chiêu mộ nhân tài từ Groq – một startup thiết kế loại chip mới gọi là LPU (đơn vị xử lý ngôn ngữ), đặc biệt phù hợp để chạy mô hình.

Theo nguồn tin từ Wall Street Journal, tại GTC tuần này, Nvidia dự kiến ra mắt nền tảng điện toán đầu tiên dùng chip của Groq: một máy chủ kết hợp phiên bản sửa đổi của GPU Rubin với bộ xử lý Groq chuyên dụng cho suy luận.

Nhiều dấu hiệu khác cũng cho thấy Nvidia đang dịch chuyển trọng tâm. Tháng 2 vừa qua, Meta Platforms cho biết sẽ lắp đặt hàng nghìn CPU Vera của Nvidia – bộ não xử lý chính của máy tính – vào các trung tâm dữ liệu AI của họ. Đây là đợt triển khai lớn đầu tiên các hệ thống AI của Nvidia mà không kèm theo GPU. Thị trường đang dần công nhận rằng điện toán suy luận có thể được xử lý bằng CPU mà không nhất thiết phải dùng đến những con chip chủ lực của Nvidia.

Tờ Journal cũng đưa tin Nvidia đang lên kế hoạch ra mắt các giải pháp điện toán mới gồm nhiều CPU hoạt động độc lập với GPU, tương tự cách Meta đang làm. Ngay cả Intel – gã khổng lồ đang chật vật vì lỡ chuyến tàu AI – cũng hé lộ về một thỏa thuận hợp tác lớn với Nvidia tại sự kiện này. Intel vốn là "vua" CPU nhưng lại thiếu chỗ đứng trong mảng GPU.

Cuộc chiến không khoan nhượng

"Các mô hình chất lượng nhất hiện nay đang dần trở nên bất khả thi nếu chạy trên cơ sở hạ tầng cũ," Shahriar Rabii, cựu giám đốc Google và Meta, đồng sáng lập Majestic Labs, cho biết.

Thỏa thuận giữa Nvidia và Groq được đẩy nhanh sau khi OpenAI – khách hàng lớn nhất của họ – ký kết hợp đồng 10 tỷ USD với startup Cerebras. Tuần trước, Cerebras tiếp tục lấn sân khi công bố Amazon Web Services (AWS) là khách hàng mới nhất. Andrew Feldman, CEO của Cerebras, đã liên tục "tấn công" Nvidia trên mạng xã hội, khẳng định Nvidia sẽ tụt hậu vì thư viện lập trình độc quyền CUDA của họ chỉ thực sự cần cho huấn luyện chứ không phải suy luận. "Không có 'con hào' CUDA nào trong mảng suy luận cả," Feldman tuyên bố.

Tom Burke, Giám đốc doanh thu của Nscale (nhà cung cấp đám mây tại Anh), cho rằng sự trỗi dậy của suy luận đang tái định hình bản đồ năng lượng tính toán. Ông dự đoán các công ty AI sẽ sớm đa dạng hóa nhà cung cấp chip: "12 tháng trước, tỉ lệ nhu cầu tính toán là 90/10 nghiêng về huấn luyện. Đến cuối năm nay, tôi tin con số này sẽ đảo chiều."

Vị thế dẫn đầu của Nvidia giờ đây phụ thuộc vào việc họ xoay trục lộ trình sản phẩm nhanh đến mức nào. Nếu các dòng chip mới hợp tác cùng Groq chứng minh được tốc độ và hiệu quả về chi phí, họ sẽ tiếp tục giữ ngôi vương. Colette Kress, Giám đốc tài chính của Nvidia, vẫn đầy tự tin: "Hiện tại, chúng tôi vẫn là vị vua của suy luận."